机器学习的学习方法主要包括以下几种:

2. 无监督学习(Unsupervised Learning):这种方法不依赖于标注数据,而是从未标注的数据中学习数据的内在结构和模式。无监督学习常用于聚类、降维和关联规则学习等任务。

3. 半监督学习(Semisupervised Learning):这是一种结合了监督学习和无监督学习的方法。在这种方法中,模型使用一小部分标注数据(监督学习)和大量未标注数据(无监督学习)进行训练。

4. 强化学习(Reinforcement Learning):这是一种通过与环境交互来学习最佳决策策略的方法。强化学习模型通过与环境的交互,学习如何在特定情境下采取行动以最大化奖励。

5. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

6. 联邦学习(Federated Learning):这是一种在多个设备上分布式训练模型的方法,同时保持数据本地化。联邦学习旨在解决数据隐私和安全性问题。

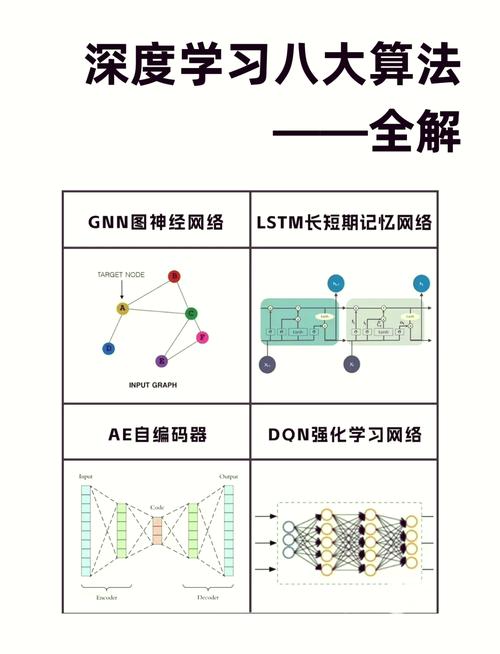

7. 深度学习(Deep Learning):这是一种使用人工神经网络进行学习的机器学习方法。深度学习模型通常包含多个隐藏层,能够自动学习数据的复杂特征表示。

8. 集成学习(Ensemble Learning):这是一种结合多个模型以提高预测性能的方法。集成学习可以通过多种方式实现,如袋装(Bagging)、提升(Boosting)和堆叠(Stacking)。

9. 多任务学习(Multitask Learning):这是一种同时学习多个相关任务的方法。多任务学习可以提高模型的泛化能力,尤其是在数据稀缺的情况下。

10. 主动学习(Active Learning):这是一种让模型主动选择最有信息量的样本进行标注的方法。主动学习可以减少标注成本,同时提高模型的性能。

11. 元学习(Meta Learning):这是一种让模型学习如何学习的方法。元学习模型通常在多个任务上进行训练,以快速适应新任务。

12. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

13. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

14. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

15. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

16. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

17. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

18. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

19. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

20. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

21. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

22. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

23. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

24. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

25. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

26. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

27. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

28. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

29. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

30. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

31. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

32. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

33. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

34. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

35. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

36. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

37. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

38. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

39. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

40. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

41. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

42. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

43. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

44. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

45. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

46. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

47. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

48. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

49. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

50. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

51. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

52. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

53. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

54. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

55. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

56. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

57. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

58. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

59. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

60. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

61. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

62. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

63. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

64. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

65. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

66. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

67. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

68. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

69. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

70. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

71. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

72. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

73. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

74. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

75. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

76. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

77. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

78. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

79. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

80. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

81. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

82. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

83. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

84. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

85. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

86. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

87. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

88. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

89. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

90. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

91. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

92. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

93. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

94. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

95. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

96. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

97. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

98. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

99. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

100. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

101. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

102. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

103. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

104. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

105. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

106. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据机器学习的学习方法主要包括以下几种:

2. 无监督学习(Unsupervised Learning):这种方法不依赖于标注数据,而是从未标注的数据中学习数据的内在结构和模式。无监督学习常用于聚类、降维和关联规则学习等任务。

3. 半监督学习(Semisupervised Learning):这是一种结合了监督学习和无监督学习的方法。在这种方法中,模型使用一小部分标注数据(监督学习)和大量未标注数据(无监督学习)进行训练。

4. 强化学习(Reinforcement Learning):这是一种通过与环境交互来学习最佳决策策略的方法。强化学习模型通过与环境的交互,学习如何在特定情境下采取行动以最大化奖励。

5. 迁移学习(Transfer Learning):这是一种将一个模型在某个任务上学到的知识应用到另一个相关任务上的方法。迁移学习常用于处理数据稀缺或任务相似的情况。

6. 联邦学习(Federated Learning):这是一种在多个设备上分布式训练模型的方法,同时保持数据本地化。联邦学习旨在解决数据隐私和安全性问题。

7. 深度学习(Deep Learning):这是一种使用人工神经网络进行学习的机器学习方法。深度学习模型通常包含多个隐藏层,能够自动学习数据的复杂特征表示。

8. 集成学习(Ensemble Learning):这是一种结合多个模型以提高预测性能的方法。集成学习可以通过多种方式实现,如袋装(Bagging)、提升(Boosting)和堆叠(Stacking)。

9. 多任务学习(Multitask Learning):这是一种同时学习多个相关任务的方法。多任务学习可以提高模型的泛化能力,尤其是在数据稀缺的情况下。

10. 主动学习(Active Learning):这是一种让模型主动选择最有信息量的样本进行标注的方法。主动学习可以减少标注成本,同时提高模型的性能。

11. 元学习(Meta Learning):这是一种让模型学习如何学习的方法。元学习模型通常在多个任务上进行训练,以快速适应新任务。

12. 长期记忆网络(Long ShortTerm Memory, LSTM):这是一种特殊的循环神经网络(RNN),用于处理序列数据,如时间序列和自然语言处理任务。

13. 生成对抗网络(Generative Adversarial Network, GAN):这是一种由生成器和判别器组成的网络,用于生成逼真的数据,如图像和音频。

14. 图神经网络(Graph Neural Network, GNN):这是一种处理图结构数据的神经网络,常用于社交网络分析、推荐系统和知识图谱等任务。

15. 多模态学习(Multimodal Learning):这是一种同时处理多种类型数据(如图像、文本和音频)的方法。多模态学习可以提高模型的泛化能力和鲁棒性。

16. 自监督学习(Selfsupervised Learning):这是一种使用未标注数据进行训练的方法,通过预测数据中的隐藏特征或关系来学习。自监督学习可以减少标注成本,同时提高模型的性能。

这些学习方法各有特点,适用于不同的场景和任务。在实际应用中,选择合适的学习方法需要根据具体问题和数据的特点进行综合考虑。

机器学习的学习方法:全面解析与实战指南

一、基础知识学习

1.1 数学基础

机器学习涉及大量的数学知识,如线性代数、概率论、统计学等。掌握这些基础知识是学习机器学习的前提。可以通过阅读相关教材、在线课程或参加培训班来学习。

1.2 编程基础

Python是目前机器学习领域最常用的编程语言。学习Python编程,掌握基本语法和数据结构,为后续学习打下基础。

1.3 机器学习基础

了解机器学习的基本概念、算法和模型,如监督学习、无监督学习、强化学习等。可以通过阅读教材、在线课程或参加相关研讨会来学习。

二、实战项目经验

2.1 数据集获取与处理

实战项目需要从数据集获取和处理开始。了解常用的数据集获取渠道,如UCI机器学习库、Kaggle等。学习数据清洗、数据预处理等技能,为后续模型训练做好准备。

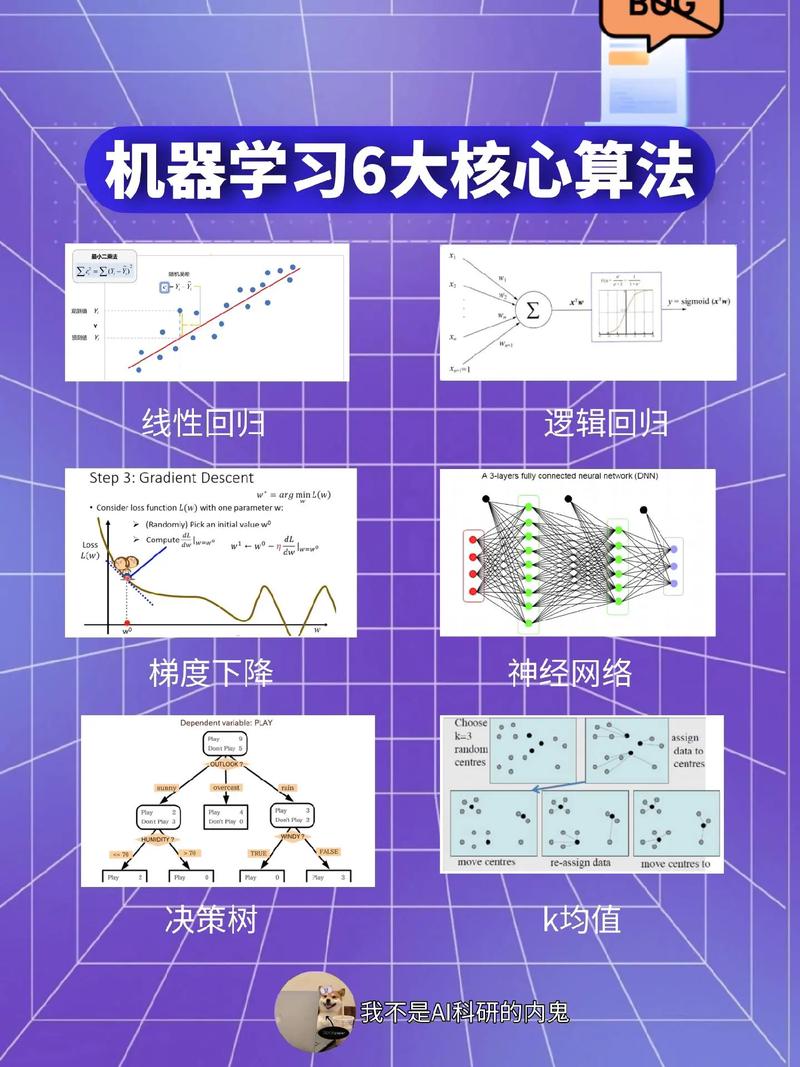

2.2 模型选择与调优

根据实际问题选择合适的模型,如线性回归、决策树、支持向量机等。学习模型调优技巧,如交叉验证、网格搜索等,以提高模型性能。

2.3 模型评估与优化

了解常用的模型评估指标,如准确率、召回率、F1值等。根据评估结果对模型进行优化,提高模型在未知数据上的表现。

三、深度学习与神经网络

3.1 深度学习基础

了解深度学习的基本概念、网络结构、训练方法等。学习常用的深度学习框架,如TensorFlow、PyTorch等。

3.2 神经网络模型

学习常见的神经网络模型,如卷积神经网络(CNN)、循环神经网络(RNN)、长短期记忆网络(LSTM)等,并了解其在不同领域的应用。

3.3 模型优化与可视化

学习深度学习模型优化技巧,如批量归一化、Dropout等。掌握模型可视化方法,如TensorBoard等,以便更好地理解模型训练过程。

四、实战项目实战

4.1 项目选题与规划

根据个人兴趣和实际需求,选择合适的实战项目。制定项目规划,明确项目目标、时间安排和资源分配。

4.2 项目实施与调试

按照项目规划,逐步实施项目。在实施过程中,遇到问题时,及时查找资料、请教他人,并进行调试。

五、持续学习与拓展

5.1 关注最新动态

机器学习领域发展迅速,关注最新动态有助于跟上技术发展步伐。可以通过阅读论文、参加学术会议、关注技术博客等方式获取最新信息。

5.2 拓展知识面学习其他相关领域的知识,如自然语言处理、计算机视觉等,有助于拓宽视野,提高解决问题的能力。

通过以上五个方面的学习,相信读者可以全面掌握机器学习的学习方法,为成为一名优秀的机器学习工程师打下坚实基础。