-

吃娱乐圈的瓜不如,吃瓜不如看真相,深度解析幕后故事

亲爱的读者们,你是不是也和我一样,每天刷着手机,追着娱乐圈的八卦新闻,仿佛不这样就不能跟上时代的潮流?但你知道吗?有时候,放下那...

2025-11-02 345 -

恐怖小漫画,暗夜阴影下的恐怖故事

亲爱的读者,你是否曾在某个深夜,被那些诡异的画面和令人毛骨悚然的情节所吸引?没错,今天我要和你分享的就是那些让人心跳加速的恐怖小...

2025-11-02 452 -

女警漫画,漫画中的正义守护者

你知道吗?在互联网的世界里,有一种独特的艺术形式,它不仅让人捧腹大笑,还能让人感受到正义的力量。这就是——女警漫画!今天,就让我...

2025-09-22 354 -

娱乐圈吃瓜爆料王楚然

娱乐圈吃瓜爆料王楚然:揭秘娱乐圈背后的故事亲爱的读者们,你是否厌倦了娱乐圈的喧嚣和炒作?是否渴望一探究竟,了解那些明星背后的真实...

2025-09-21 493 -

《风云》漫画,江湖风云再起,英雄豪杰逐梦江湖

亲爱的漫画迷们,今天我要和你聊聊一部超级经典的漫画——《风云》。这部漫画自问世以来,就以其独特的画风、跌宕起伏的剧情和深入人心的...

2025-09-11 453 -

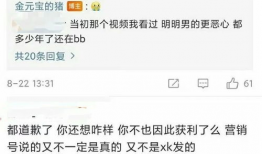

娱乐圈吃瓜爆料家暴男,家暴男生身份曝光,真相令人震惊!

娱乐圈,这个光鲜亮丽的舞台,背后却隐藏着无数不为人知的秘密。今天,我们就来聊聊娱乐圈中那些吃瓜爆料家暴男的故事。一、家暴,娱乐圈...

2025-09-11 472 -

娱乐圈吃瓜买西瓜,娱乐圈瓜田乐享西瓜时光

娱乐圈吃瓜买西瓜:揭秘明星们的“瓜田”亲爱的读者们,你是否也和我一样,对娱乐圈的八卦新闻充满了好奇?在这个信息爆炸的时代,明星们...

2025-09-09 477 -

91班直播课,探索知识海洋,共筑学习新篇章

亲爱的读者们,你是否曾在某个夜晚,对着手机屏幕,好奇地窥探着那些神秘的直播课堂?今天,就让我带你一起走进91班直播课的世界,看看...

2025-09-09 452 -

gto漫画,激情四溢的校园风云,热血青春的逆袭传奇

你有没有发现,最近你的朋友圈里是不是也被GTO漫画刷屏了?没错,就是那个让人笑到肚子疼,又忍不住感慨人生百态的GTO漫画!今天,...

2025-09-09 482 -

纳屋漫画,奇幻冒险之旅,探索未知世界的神秘篇章

你有没有听说过纳屋漫画?最近这可是网上热议的话题呢!想象一个充满奇幻色彩的漫画世界,里面的人物各具特色,故事情节跌宕起伏,是不是...

2025-09-09 434