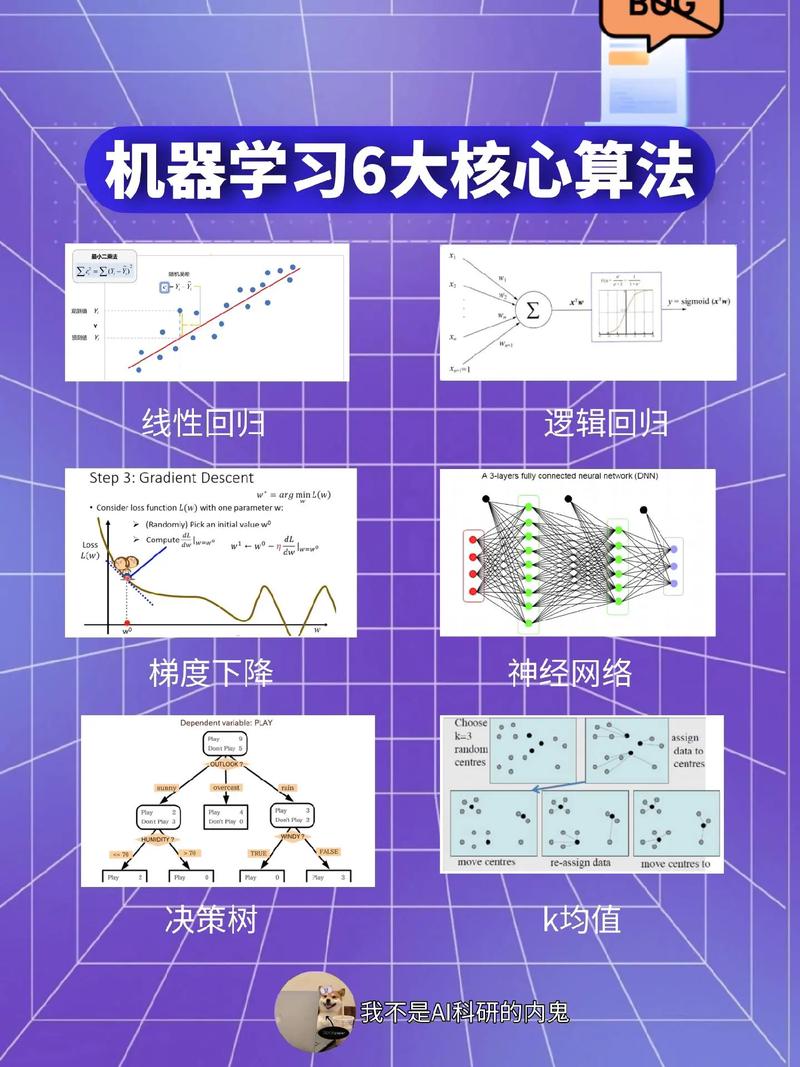

1. 线性回归:一种预测连续数值型输出的方法,通过找到最佳拟合直线来最小化预测误差。

2. 逻辑回归:一种分类算法,通过估计事件发生的概率来预测二元结果。

3. 决策树:一种基于树形结构的分类和回归方法,通过一系列规则对数据进行划分。

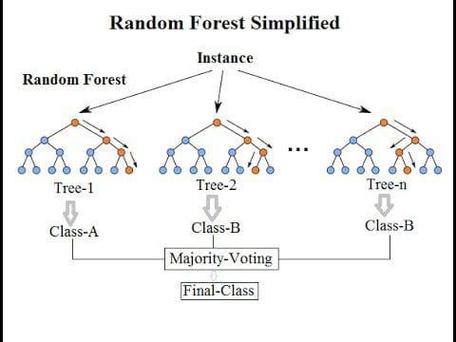

4. 随机森林:一种集成学习方法,通过构建多个决策树并取平均值来提高预测准确性。

5. 支持向量机(SVM):一种二分类算法,通过找到最佳超平面来最大化两类数据之间的间隔。

6. K最近邻(KNN):一种分类和回归算法,通过找到与待预测数据最相似的K个邻居并取平均值来预测输出。

7. K均值聚类:一种无监督学习方法,通过将数据划分为K个簇来发现数据中的内在结构。

8. 主成分分析(PCA):一种降维方法,通过找到数据中的主要特征来减少特征数量。

9. 奇异值分解(SVD):一种降维方法,通过将数据分解为三个矩阵来减少特征数量。

10. 神经网络:一种模拟人脑神经元结构的计算模型,通过学习输入和输出之间的关系来预测输出。

这些算法在不同的应用场景中发挥着重要作用,可以根据具体问题选择合适的算法进行模型训练和预测。

机器学习经典算法:探索与理解

随着信息技术的飞速发展,机器学习作为人工智能的核心领域之一,已经广泛应用于各个行业。机器学习算法是机器学习的基础,本文将介绍几种经典的机器学习算法,帮助读者更好地理解和应用这些算法。

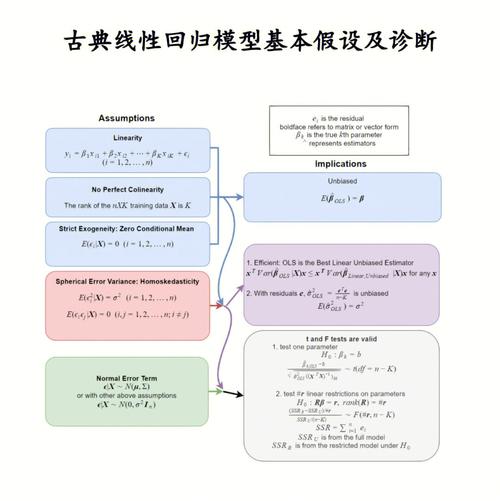

1. 线性回归(Linear Regression)

线性回归是一种简单的预测模型,用于预测连续值。它假设数据之间存在线性关系,通过最小化预测值与实际值之间的误差来训练模型。

线性回归的数学表达式为:y = mx b,其中y为预测值,x为自变量,m为斜率,b为截距。

线性回归适用于数据量较小、特征较少的情况,是机器学习的基础算法之一。

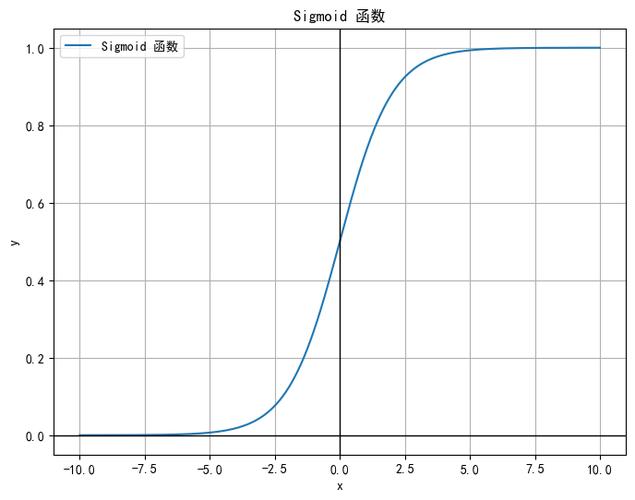

2. 逻辑回归(Logistic Regression)

逻辑回归是一种用于分类问题的算法,它通过将线性回归的输出转换为概率值来预测样本的类别。

逻辑回归的数学表达式为:P(y=1) = 1 / (1 e^(-z)),其中z = wx b,w为权重,b为偏置。

逻辑回归适用于二分类问题,是分类算法中的基础。

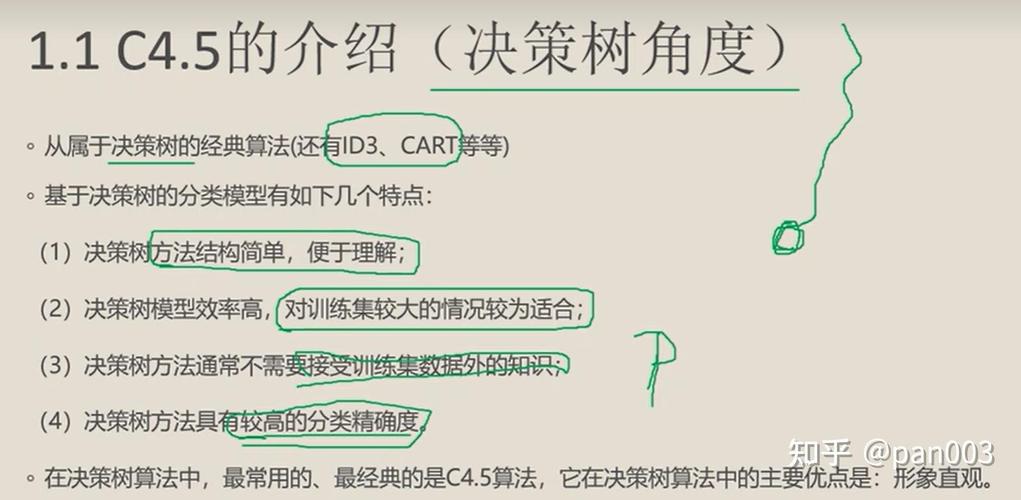

3. 决策树(Decision Tree)

决策树是一种基于树形结构的分类和回归算法,通过一系列的决策规则将数据集划分为不同的子集。

决策树的构建过程如下:

选择最优特征进行分裂,通常使用信息增益或基尼指数作为评价标准。

根据特征的不同取值,将数据集划分为不同的子集。

递归地对子集进行相同的操作,直到满足停止条件。

决策树具有直观易懂、可解释性强等优点,适用于处理各种类型的数据。

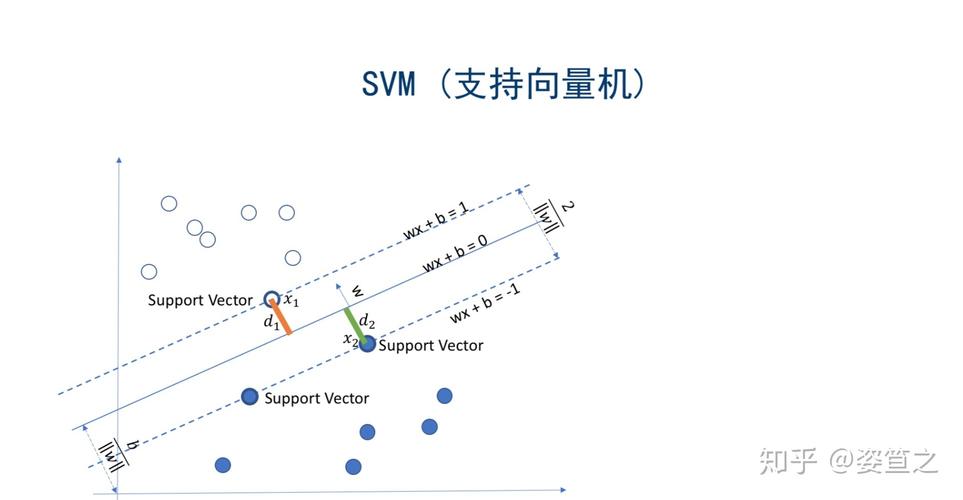

4. 支持向量机(Support Vector Machine, SVM)

支持向量机是一种基于间隔最大化的分类算法,通过寻找最优的超平面将数据集划分为不同的类别。

支持向量机的核心思想是最大化分类间隔,即最大化不同类别之间的距离。

支持向量机适用于处理高维数据,具有较好的泛化能力。

5. 随机森林(Random Forest)

随机森林是一种集成学习方法,通过构建多个决策树并对它们的预测结果进行投票来提高模型的准确性和稳定性。

随机森林的构建过程如下:

从原始数据集中随机抽取一定数量的样本。

对每个样本构建一个决策树。

对每个决策树的预测结果进行投票,得到最终的预测结果。

随机森林具有较好的抗过拟合能力,适用于处理大规模数据。

本文介绍了机器学习中的几种经典算法,包括线性回归、逻辑回归、决策树、支持向量机和随机森林。这些算法在机器学习领域具有广泛的应用,读者可以根据实际需求选择合适的算法进行应用。

随着机器学习技术的不断发展,新的算法和模型不断涌现,但经典算法仍然具有重要的研究价值和实际应用价值。