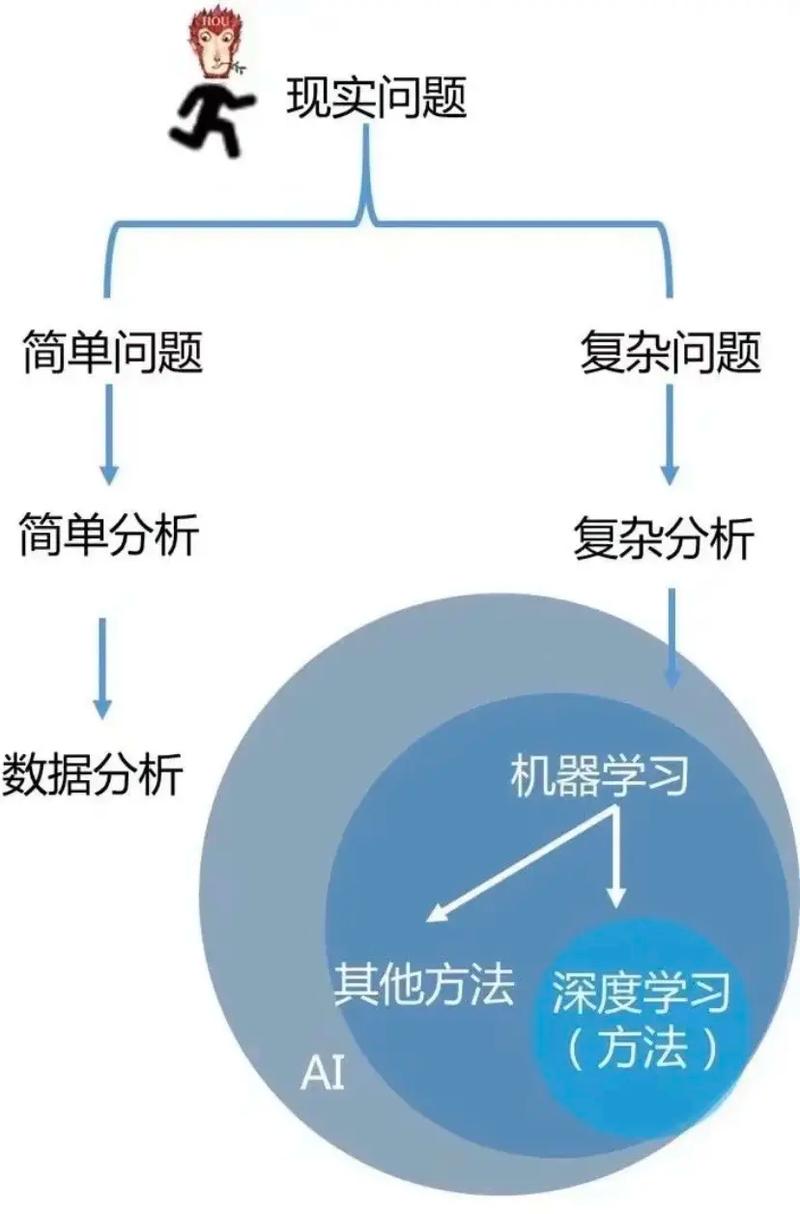

什么是杀戮机器学习?

杀戮机器学习是指利用机器学习技术,使机器具备自主决策和执行杀戮的能力。这种技术通常涉及以下几个方面:

目标识别:通过图像识别、声音识别等技术,机器能够识别和锁定目标。

决策制定:基于预设的规则或算法,机器能够自主判断何时采取行动。

执行行动:通过机械臂、无人机等执行设备,机器能够对目标进行攻击或破坏。

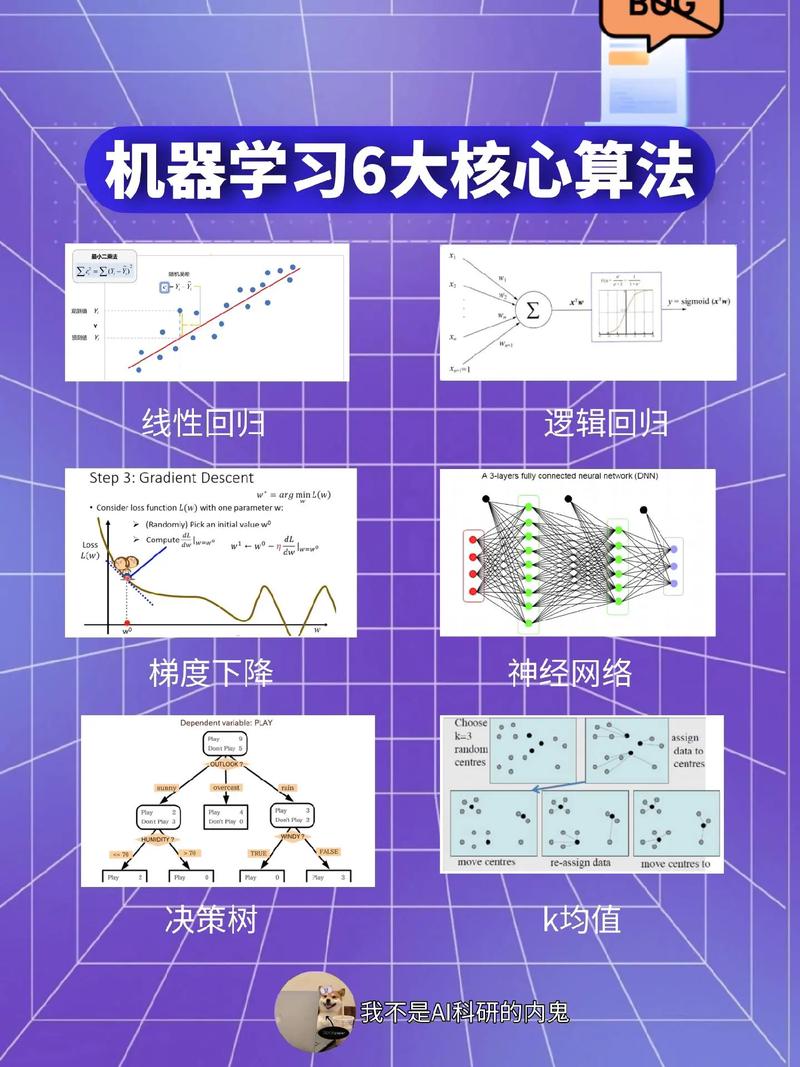

技术原理

杀戮机器学习主要依赖于以下技术原理:

深度学习:通过神经网络模型,机器能够从大量数据中学习并提取特征。

强化学习:通过不断试错和奖励惩罚机制,机器能够优化其决策过程。

计算机视觉:通过图像处理技术,机器能够识别和理解视觉信息。

潜在风险

尽管杀戮机器学习具有巨大的应用潜力,但其潜在风险也不容忽视:

误伤无辜:由于技术限制或算法缺陷,机器可能错误地将无辜者视为目标。

滥用风险:杀戮机器可能被用于非法或恐怖活动,对人类造成威胁。

伦理问题:杀戮机器的决策过程可能涉及伦理道德问题,如自主权、责任归属等。

应对措施

为了应对杀戮机器学习的潜在风险,以下措施值得关注:

加强监管:政府和企业应加强对杀戮机器学习的监管,确保其合法合规使用。

伦理审查:在研发和应用杀戮机器学习技术时,应进行严格的伦理审查,确保其符合道德规范。

技术限制:通过技术手段限制杀戮机器的自主决策能力,降低误伤风险。

国际合作:加强国际间的合作,共同应对杀戮机器学习带来的挑战。

案例分析

无人机:无人机在军事和民用领域得到广泛应用,但同时也存在被用于恐怖袭击的风险。

面部识别技术:面部识别技术在公共安全领域具有重要作用,但可能被用于非法监控和追踪。

智能武器:智能武器能够自主识别和攻击目标,但可能被滥用,对平民造成伤害。

结论

杀戮机器学习是一把双刃剑,既能为人类带来便利,也可能带来巨大的风险。在享受其带来的便利的同时,我们必须警惕其潜在的黑暗面,并采取有效措施应对。只有这样,我们才能确保人工智能技术在和平、安全的环境中发挥积极作用。

杀戮机器学习 人工智能 技术风险 伦理问题 应对措施