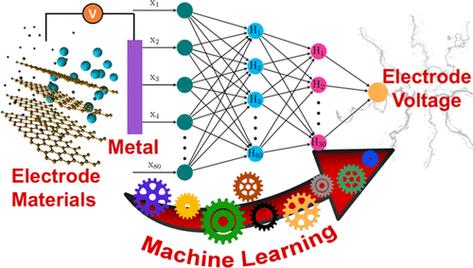

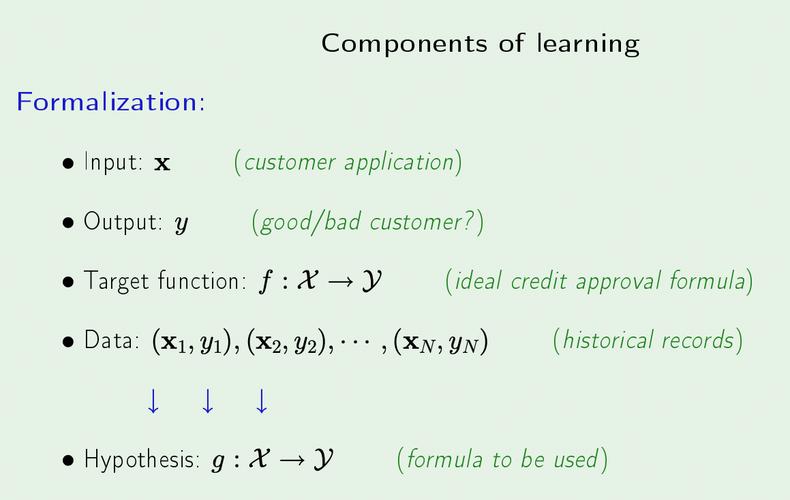

机器学习中的统计方法是指运用统计学原理和方法来解决机器学习问题的一系列技术。这些方法可以帮助我们更好地理解数据、建立模型、评估模型性能以及进行预测。以下是机器学习中常用的统计方法:

1. 概率论与数理统计:概率论是研究随机现象规律性的数学分支,数理统计则是利用概率论的基本原理和方法来处理实际问题的学科。在机器学习中,概率论与数理统计是构建模型和进行预测的基础。2. 假设检验:假设检验是统计学中用来判断某个假设是否成立的统计方法。在机器学习中,假设检验可以用来评估模型的有效性,判断模型的参数是否显著,以及比较不同模型的性能等。3. 参数估计:参数估计是指根据样本数据来估计总体参数的值。在机器学习中,参数估计是构建模型的重要步骤,常用的参数估计方法包括最大似然估计、贝叶斯估计等。4. 回归分析:回归分析是统计学中研究一个或多个自变量与因变量之间关系的方法。在机器学习中,回归分析可以用来建立预测模型,对数据进行预测和分析。5. 决策树与随机森林:决策树是一种基于树结构的分类和回归方法,随机森林则是对决策树进行集成的一种方法。这些方法在机器学习中常用于分类和回归问题。6. 支持向量机:支持向量机是一种基于最大间隔原理的分类方法,常用于处理高维数据。在机器学习中,支持向量机可以用于分类、回归和异常检测等问题。7. 隐马尔可夫模型:隐马尔可夫模型是一种基于马尔可夫链的统计模型,常用于处理序列数据。在机器学习中,隐马尔可夫模型可以用于语音识别、自然语言处理等领域。8. 聚类分析:聚类分析是一种将数据划分为若干个类别的统计方法。在机器学习中,聚类分析可以用于数据挖掘、异常检测等问题。

这些统计方法在机器学习中发挥着重要作用,它们可以帮助我们更好地理解数据、建立模型、评估模型性能以及进行预测。在实际应用中,根据问题的特点和数据的特点选择合适的统计方法是非常关键的。

机器学习的统计方法:概述

随着大数据时代的到来,机器学习在各个领域得到了广泛应用。机器学习算法的核心在于从数据中学习规律,而统计方法则是实现这一目标的重要工具。本文将介绍机器学习中常用的统计方法,帮助读者更好地理解这些方法在机器学习中的应用。

描述性统计是统计学的基础,用于描述数据的特征。在机器学习中,描述性统计方法可以帮助我们了解数据的分布情况、集中趋势和离散程度。常用的描述性统计方法包括:

均值(Mean):数据集中所有数值的平均值。

中位数(Median):将数据集从小到大排序后,位于中间位置的数值。

众数(Mode):数据集中出现次数最多的数值。

方差(Variance)和标准差(Standard Deviation):衡量数据集中数值的离散程度。

推断性统计是统计学的高级阶段,用于从样本数据推断总体特征。在机器学习中,推断性统计方法可以帮助我们评估模型的性能、进行假设检验和建立置信区间。常用的推断性统计方法包括:

假设检验(Hypothesis Testing):通过比较样本数据和总体数据,判断总体参数是否满足某个假设。

置信区间(Confidence Interval):根据样本数据,估计总体参数的可能范围。

相关系数(Correlation Coefficient):衡量两个变量之间的线性关系强度和方向。

特征选择(Feature Selection):从原始特征中挑选出对模型性能有显著影响的特征。

特征提取(Feature Extraction):通过变换原始数据,生成新的特征。

特征编码(Feature Encoding):将类别型数据转换为数值型数据,以便模型处理。

准确率(Accuracy):模型正确预测的样本数占总样本数的比例。

召回率(Recall):模型正确预测的阳性样本数占总阳性样本数的比例。

精确率(Precision):模型正确预测的阳性样本数占总预测阳性样本数的比例。

F1 分数(F1 Score):精确率和召回率的调和平均数。

K-Means 聚类:将数据集划分为 K 个类别,使得每个类别内的数据点距离类别中心的距离最小。

层次聚类:将数据集按照相似度进行划分,形成一棵树状结构。

DBSCAN 聚类:基于密度的聚类方法,将数据点划分为簇,簇内的数据点密度较高,簇间的数据点密度较低。

线性回归(Linear Regression):通过线性关系预测连续值。

逻辑回归(Logistic Regression):通过线性关系预测概率。

支持向量机(Support Vector Machine,SVM):通过寻找最优的超平面将数据集划分为两个类别。

决策树(Decision Tree):通过树状结构对数据进行分类或回归。

机器学习中的统计方法多种多样,本文仅介绍了其中一部分。在实际应用中,我们需要根据具体问题选择合适的统计方法,以提高模型的性能。随着机器学习技术的不断发展,统计方法在机器学习