统计学习方法和机器学习是两个密切相关但又有区别的概念。以下是它们的基本定义、主要方法和应用场n 机器学习机器学习是人工智能的一个分支,它使计算机系统能够利用数据和算法自动学习和改进其性能。机器学习的研究主要分为两类:1. 传统机器学习:研究学习机制,注重探索模拟人的学习机制。2. 大数据环境下的机器学习:研究如何有效利用信息,注重从巨量数据中获取隐藏的、有效的、可理解的知识。

统计学习方法与机器学习的联系和区别 联系:统计学习方法是机器学习的重要组成部分,许多机器学习算法都是基于统计学的原理和方法构建的。 区别: 目的:机器学习模型旨在使最准确的预测成为可能,而统计模型被设计用于推断变量之间的关系。 应用场n 学习资源 李航老师的《统计学习方法》:这本书全面系统地介绍了统计学习的主要方法,适合作为机器学习的入门书籍。 机器学习入门教程:涵盖了机器学习的概念、算法、应用、流程、Python库、实战案例等内容,适合初学者学习和复习。

通过这些资源,你可以系统地学习和掌握统计学习方法和机器学习的基本概念、算法和应用。

深入浅出统计学习方法在机器学习中的应用

随着信息技术的飞速发展,机器学习已经成为人工智能领域的研究热点。统计学习方法作为机器学习的基础,其在各个领域的应用日益广泛。本文将深入浅出地介绍统计学习方法在机器学习中的应用,帮助读者更好地理解这一重要领域。

一、什么是统计学习方法?

统计学习方法是一种基于概率论和数理统计理论,通过分析数据特征,建立数学模型,从而对未知数据进行预测或分类的方法。其主要目的是从数据中提取规律,为实际问题提供解决方案。

二、统计学习方法在机器学习中的应用

1. 监督学习

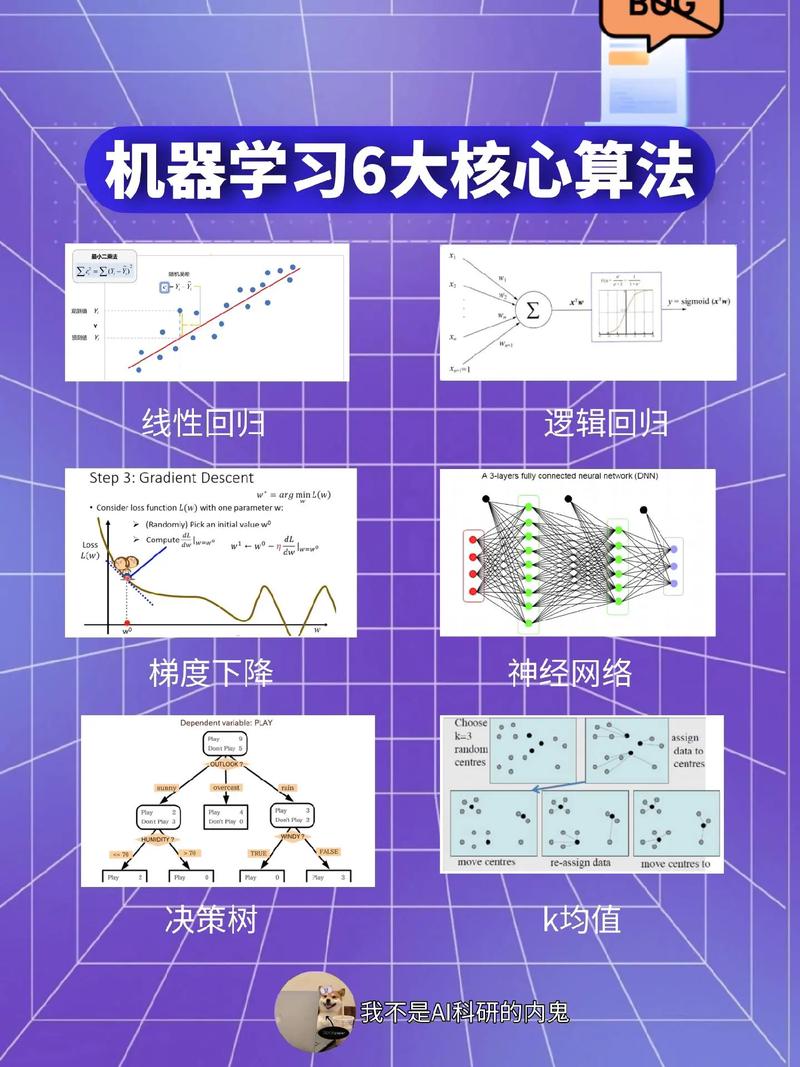

监督学习是统计学习方法在机器学习中最常见的一种应用。其主要任务是通过已知的输入和输出数据,学习一个映射规则,从而对新的输入数据进行预测。常见的监督学习方法包括线性回归、逻辑回归、支持向量机(SVM)等。

2. 无监督学习

无监督学习是另一种重要的统计学习方法,其主要任务是从未标记的数据中寻找规律,对数据进行聚类或降维。常见的无监督学习方法包括K-means聚类、主成分分析(PCA)、自编码器等。

3. 强化学习

强化学习是一种通过与环境交互,不断学习最优策略的统计学习方法。其主要应用领域包括游戏、机器人控制、推荐系统等。常见的强化学习方法包括Q学习、深度Q网络(DQN)等。

三、线性回归模型

线性回归是一种经典的统计学习方法,主要用于回归问题。其基本思想是建立一个线性模型,通过最小化误差平方和来拟合数据。线性回归模型可以表示为:y = β0 β1x1 β2x2 ... βnxn,其中y为因变量,x1, x2, ..., xn为自变量,β0, β1, ..., βn为模型参数。

线性回归模型在实际应用中具有广泛的应用,如房价预测、股票价格预测等。

四、K-means聚类算法

K-means聚类是一种常用的无监督学习方法,其主要思想是将数据集划分为K个簇,使得每个簇内的数据点尽可能接近,而不同簇之间的数据点尽可能远离。K-means聚类算法的具体步骤如下:

随机选择K个数据点作为初始聚类中心。

将每个数据点分配到最近的聚类中心所在的簇。

更新聚类中心,计算每个簇的平均值。

重复步骤2和3,直到聚类中心不再发生变化或达到预设的迭代次数。

K-means聚类算法在图像处理、文本挖掘等领域具有广泛的应用。

五、决策树

决策树是一种常用的监督学习方法,其主要思想是通过一系列的决策规则,将数据集划分为不同的子集,从而实现对数据的分类或回归。决策树算法的具体步骤如下:

选择一个特征作为根节点。

根据该特征将数据集划分为不同的子集。

对每个子集递归地执行步骤1和2,直到满足停止条件。

决策树在数据挖掘、金融风控等领域具有广泛的应用。

六、集成学习

集成学习是一种将多个模型组合起来,以提高预测准确率和泛化能力的统计学习方法。常见的集成学习方法包括Bagging、Boosting等。

1. Bagging

Bagging是一种通过随机选择训练样本,构建多个模型,然后对预测结果进行投票或平均的方法。Bagging可以有效地降低过拟合,提高模型的泛化能力。

2. Boosting

Boosting是一种通过迭代地训练多个模型,每次迭代都关注前一次迭代预测错误的样本,从而提高模型对错误样本的预测能力的方法。Boosting在处理小样本问题时具有较好的效果。

统计学习方法在机器学习中的应用非常广泛,本文介绍了监督学习、无监督学习、强化学习等统计学习方法,以及线性回归、K-means聚类、决策树等具体算法。通过