机器学习二分类问题是指将数据集中的样本分为两类的问题。在机器学习中,二分类问题是一个非常重要的领域,广泛应用于各个领域,如垃圾邮件过滤、欺诈检测、疾病诊断等。

二分类问题通常可以使用多种机器学习算法来解决,如逻辑回归、支持向量机、决策树、随机森林、神经网络等。在选择算法时,需要考虑数据的特征、分布、规模等因素。

二分类问题的评估指标通常包括准确率、召回率、F1分数、AUCROC等。准确率是指分类正确的样本数占总样本数的比例,召回率是指分类正确的正样本数占所有正样本数的比例,F1分数是准确率和召回率的调和平均数,AUCROC是ROC曲线下的面积,用于评估分类器的性能。

在解决二分类问题时,还需要注意过拟合和欠拟合的问题。过拟合是指模型对训练数据的拟合程度过高,导致在测试数据上的表现不佳;欠拟合是指模型对训练数据的拟合程度过低,导致在训练数据和测试数据上的表现都不好。为了避免过拟合和欠拟合,可以采用交叉验证、正则化等方法。

总之,二分类问题是机器学习中的一个重要领域,需要综合考虑数据特征、算法选择、评估指标、过拟合和欠拟合等问题,才能得到较好的分类效果。

机器学习二分类:技术原理与应用场景

随着大数据时代的到来,机器学习技术在各个领域得到了广泛应用。其中,二分类作为机器学习的基础任务之一,在金融、医疗、安全等多个领域发挥着重要作用。本文将介绍二分类的基本原理、常用算法以及应用场景。

一、二分类基本原理

二分类是指将数据集划分为两个类别,通常用0和1表示。例如,在垃圾邮件检测中,可以将邮件分为“垃圾邮件”和“正常邮件”两个类别。二分类的核心是找到一个决策边界,将数据集划分为两个类别。

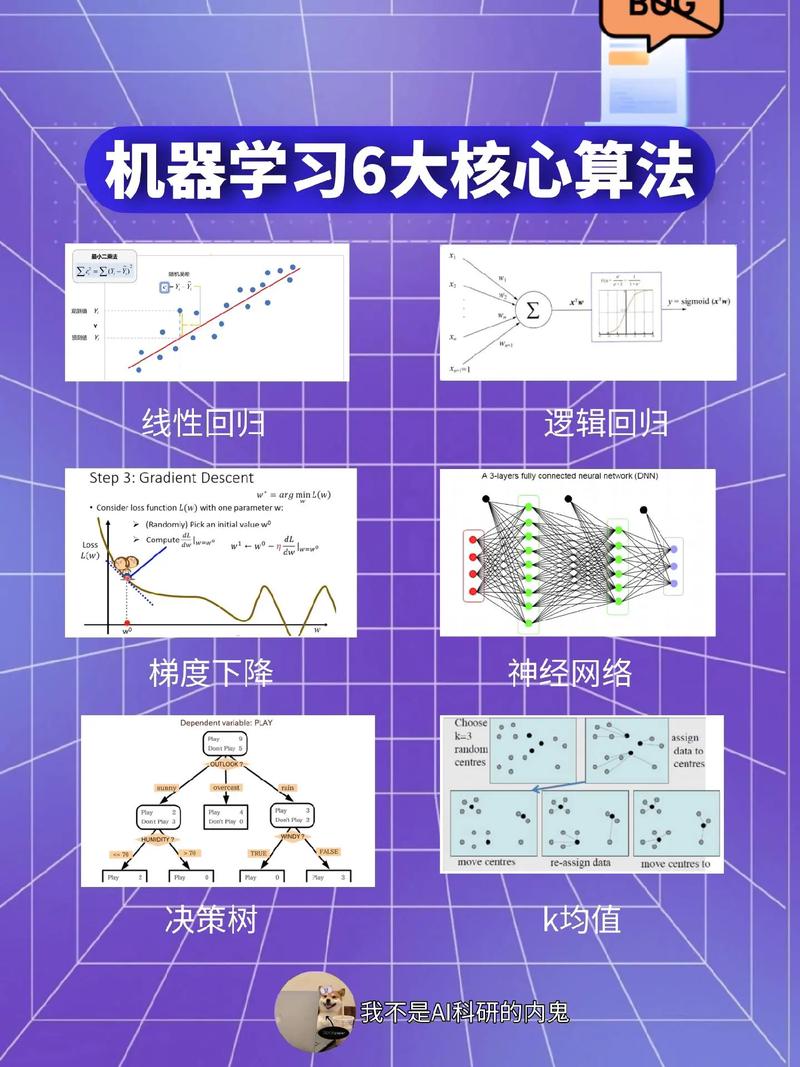

二、常用二分类算法

1. 线性回归

线性回归是一种经典的二分类算法,通过寻找一个线性函数来拟合数据,从而确定决策边界。线性回归的损失函数通常采用均方误差(MSE)或交叉熵损失函数。

2. 逻辑回归

逻辑回归是一种基于概率的线性二分类模型,通过求解逻辑函数来预测样本属于正类或负类的概率。逻辑回归的损失函数通常采用交叉熵损失函数。

3. 支持向量机(SVM)

支持向量机是一种基于间隔最大化的二分类算法,通过寻找一个最优的超平面来划分数据集。SVM的损失函数通常采用Hinge损失函数。

4. 随机森林

随机森林是一种集成学习方法,通过构建多个决策树并投票来预测结果。随机森林在处理高维数据和非线性问题时具有较好的性能。

5. XGBoost

XGBoost是一种基于梯度提升的集成学习方法,通过迭代优化决策树来提高模型的预测性能。XGBoost在处理大规模数据集时具有很高的效率。

三、二分类应用场景

1. 垃圾邮件检测

通过分析邮件内容,判断邮件是否为垃圾邮件,从而提高用户体验。

2. 金融欺诈检测

通过分析交易数据,识别潜在的金融欺诈行为,降低金融风险。

3. 医疗诊断

通过分析医学影像和患者信息,辅助医生进行疾病诊断。

4. 信用评分

通过分析个人信用数据,评估个人的信用风险。

5. 智能推荐

通过分析用户行为数据,为用户推荐感兴趣的商品或内容。

四、二分类算法的选择与优化

1. 算法选择

选择合适的二分类算法需要考虑以下因素:

(1)数据集的特点,如数据量、特征维度、数据分布等;

(2)模型的复杂度,如训练时间、预测时间等;

(3)模型的性能,如准确率、召回率、F1值等。

2. 模型优化

为了提高二分类模型的性能,可以采取以下优化措施:

(1)特征工程,如特征选择、特征提取等;

(2)模型调参,如学习率、正则化参数等;

(3)集成学习,如随机森林、XGBoost等。

二分类作为机器学习的基础任务之一,在各个领域具有广泛的应用。本文介绍了二分类的基本原理、常用算法以及应用场景,并分析了算法选择与优化的方法。在实际应用中,应根据具体问题选择合适的算法,并进行模型优化,以提高模型的预测性能。