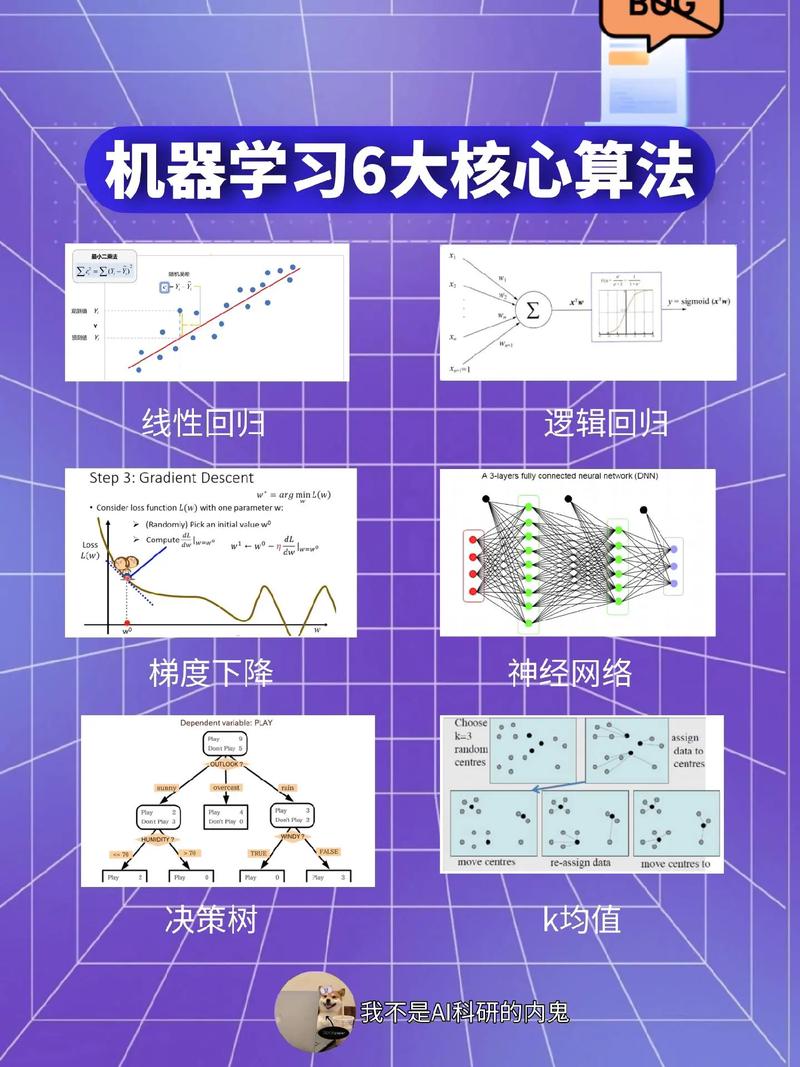

1. 线性回归(Linear Regression):用于预测连续数值型输出。

2. 逻辑回归(Logistic Regression):用于二分类问题,也可以扩展到多分类问题。

3. 决策树(Decision Tree):通过一系列规则对数据进行分类或回归。

4. 随机森林(Random Forest):由多个决策树组成,通过投票来预测结果。

5. 支持向量机(SVM):通过找到最大间隔的超平面来对数据进行分类。

6. K近邻(KNearest Neighbors, KNN):通过找到与待预测数据最相似的K个点来预测结果。

7. K均值聚类(KMeans Clustering):将数据分为K个簇,每个簇中的数据点尽可能相似。

8. 主成分分析(PCA):用于降维,通过找到数据中的主要成分来减少特征数量。

9. 神经网络(Neural Networks):由多个神经元组成,可以用于分类、回归、生成等多种任务。

10. 深度学习(Deep Learning):神经网络的一种,具有更多的层数和更复杂的结构,常用于图像识别、自然语言处理等任务。

11. 强化学习(Reinforcement Learning):通过与环境交互来学习最优策略,常用于游戏、机器人控制等任务。

12. 集成学习(Ensemble Learning):通过组合多个模型来提高预测性能,常见的集成方法有Bagging、Boosting等。

这些算法涵盖了机器学习中的许多基本概念和任务,是学习和研究机器学习的基础。在实际应用中,可能需要根据具体问题和数据特点选择合适的算法,并进行适当的调整和优化。

机器学习必学算法概述

线性回归

线性回归是机器学习中最为基础的算法之一,主要用于预测连续值。它通过建立一个线性模型来描述输入变量与输出变量之间的关系。线性回归分为简单线性回归和多元线性回归,适用于数据量较小且特征较少的情况。

逻辑回归

逻辑回归是一种广义线性模型,常用于二分类问题。它通过Sigmoid函数将线性模型的输出压缩到0和1之间,从而实现概率预测。逻辑回归在金融、医学、市场分析等领域有着广泛的应用。

支持向量机(SVM)

支持向量机是一种二分类算法,通过寻找最优的超平面将数据集划分为两个类别。SVM在处理高维数据和非线性问题时表现出色,因此在图像识别、文本分类等领域有着广泛的应用。

决策树

决策树是一种基于树结构的分类与回归算法。它通过一系列的决策规则将数据集划分为不同的分支,最终到达叶节点,得到预测结果。决策树易于理解和实现,且在处理非线性关系时表现良好。

随机森林

随机森林是一种集成学习方法,通过构建多个决策树并对它们的预测结果进行投票来提高预测精度。随机森林在处理大规模数据集和复杂问题时具有很高的鲁棒性,是许多实际应用中的首选算法。

K最近邻(KNN)

K最近邻算法是一种基于实例的算法,通过计算待分类数据与训练集中最近K个样本的距离来预测其类别。KNN在处理小规模数据集时表现良好,但在处理大规模数据集时计算量较大。

朴素贝叶斯

朴素贝叶斯是一种基于贝叶斯定理的分类算法,假设特征之间相互独立。它适用于文本分类、情感分析等领域,具有计算简单、易于实现的特点。

以上介绍了机器学习中的几种必学算法,这些算法在各个领域都有广泛的应用。掌握这些算法有助于读者在机器学习领域取得更好的成果。当然,随着技术的发展,新的算法不断涌现,读者还需不断学习,跟上时代的步伐。