机器学习中的损失函数是用于评估模型预测值与真实值之间差异的函数。它帮助模型在训练过程中调整其参数,以最小化预测误差。以下是几种常见的损失函数:

选择合适的损失函数取决于具体的问题和数据特性。

机器学习中的损失函数:理解与优化

在机器学习领域,损失函数是一个至关重要的概念。它不仅用于衡量模型预测值与实际值之间的差异,还是优化模型参数的关键工具。本文将深入探讨损失函数的定义、类型、应用场景以及如何选择合适的损失函数来优化模型。

损失函数(Loss Function)是衡量模型预测值与实际值之间差异的函数。在机器学习中,损失函数的目的是通过最小化损失值来优化模型的参数,从而提高模型的预测准确性。

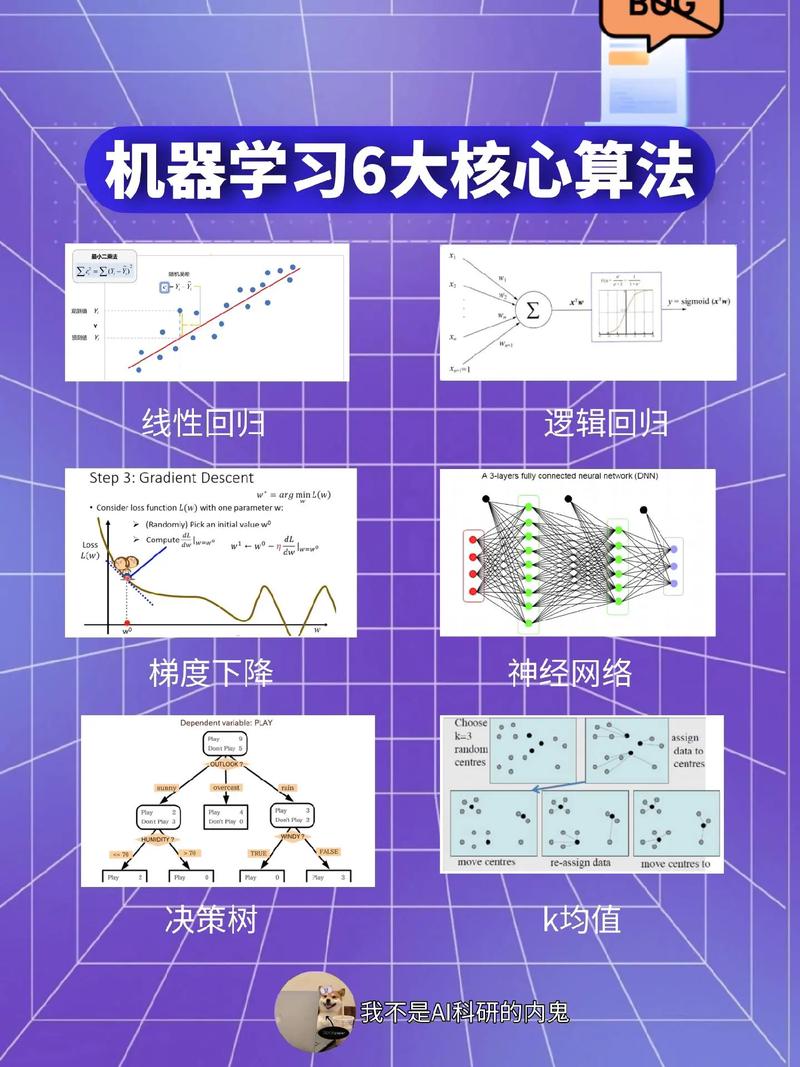

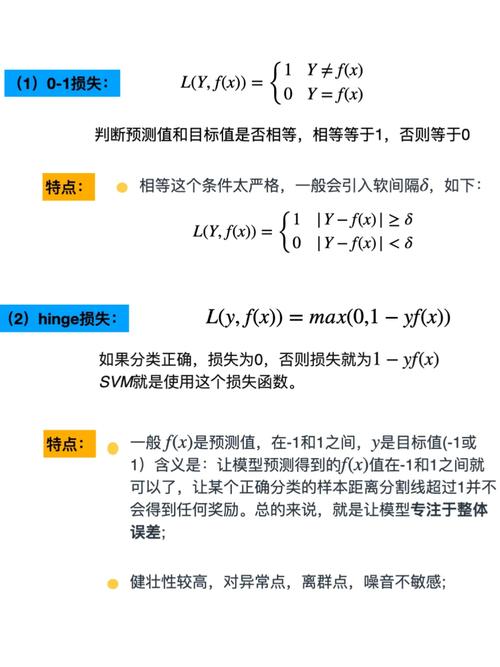

根据不同的任务和应用场景,损失函数有多种类型。以下是几种常见的损失函数:

均方误差(Mean Squared Error,MSE)是回归任务中最常用的损失函数之一。它通过计算预测值与实际值之间差的平方的平均值来衡量误差。MSE对大误差的惩罚较重,模型会倾向于避免大误差的出现。

交叉熵损失是分类任务中最常用的损失函数。它用于衡量预测的概率分布与真实分布之间的差异。交叉熵损失可以理解为用预测分布去编码真实分布的代价,如果预测越接近真实分布,交叉熵越小,模型表现越好。

绝对误差(Mean Absolute Error,MAE)是另一种回归任务中的损失函数。它通过计算预测值与实际值之间差的绝对值的平均值来衡量误差。与MSE相比,MAE对大误差的惩罚较轻,模型更关注于中等的误差。

在回归任务中,MSE和MAE是最常用的损失函数。根据具体任务的需求,可以选择MSE或MAE来优化模型参数。

在分类任务中,交叉熵损失是最常用的损失函数。它可以有效地衡量预测的概率分布与真实分布之间的差异,从而优化模型参数。

首先,根据具体的任务选择合适的损失函数。例如,回归任务选择MSE或MAE,分类任务选择交叉熵损失。

其次,考虑数据的特点。例如,如果数据中存在异常值,可以选择MAE来降低异常值对模型的影响。

使用交叉验证来评估不同损失函数的性能。通过交叉验证,可以找到最适合当前数据的损失函数。

损失函数在机器学习中扮演着至关重要的角色。通过理解损失函数的定义、类型、应用场景以及如何选择合适的损失函数,我们可以更好地优化模型参数,提高模型的预测准确性。在实际应用中,根据具体任务和数据特点选择合适的损失函数,并通过交叉验证来评估其性能,是优化模型的关键步骤。